Siamo entrati nell'era digitale: dispositivi computazionali sempre più potenti sono inseriti dappertutto e generano volumi crescenti di informazioni. La digitalizzazione di processi e prodotti implica la combinazione di conoscenze differenti: strutturate, non strutturate, testuali, visive, sonore. Emergono cambiamenti profondi ed estesi: dall'ideazione di un bene o un servizio alla diffusione sui mercati e alle interazioni con i consumatori. Le relazioni tra mondo fisico e virtuale saranno fonte di continue innovazioni grazie alla pervasività di agenti artificiali dotati di capacità prossime a quelle umane: apprendimento, adattabilità, abilità previsionali. È l''universo fisico-digitale', che richiede nuovi strumenti di conoscenza ed innovative strategie decisionali.

- English

- ePUB (mobile friendly)

- Available on iOS & Android

eBook - ePub

Fabbrica 4.0: i processi innovativi nel Multiverso fisico-digitale

About this book

Trusted by 375,005 students

Access to over 1.5 million titles for a fair monthly price.

Study more efficiently using our study tools.

Information

Capitolo 1

Lo scenario della Fabbrica Intelligente: spazio connettivo globale, digital ubiquity, Multiverso

Iniziamo un’esplorazione intellettuale dello scenario incentrato sulla ‘Fabbrica Intelligente’ considerando, insieme a Beinhocker (2006), due tribù di umani: 1) gli Yanomomö, cacciatori-raccoglitori che vivono lungo il fiume Orinoco, al confine tra Venezuela e Brasile, e utilizzano strumenti di pietra; 2) i New Yorkers, che parlano attraverso smartphone e bevono caffellatte sulle rive del fiume Hudson.

Le due tribù hanno gli stessi geni e sono quindi assolutamente identici sul piano della biologia e delle capacità umane. I primi vivono in gruppi di 40-50 persone, commerciano in prodotti presi dalla foresta (frutta, vegetali), costruiscono canestri, amache, armi. Il loro reddito annuale è di 90 dollari (calcolo teorico, perché non usano moneta), mentre quello dei New Yorkers è di 36.000 dollari. Anche l’aspettativa di vita e le possibilità di fronteggiare malattie e minacce dell’ambiente sono tra i primi più basse. Non si tratta però di esprimere una valutazione morale e tecnico-scientifica su ‘chi è più felice’ oppure in sintonia con l’ambiente in cui vive. Il dato saliente secondo Beinhocker e interessante ai nostri fini è un altro: quello che caratterizza i New Yorkers non è il livello del reddito in termini assoluti, bensì l’incredibile varietà di scelte che il loro reddito consente di acquistare: «il numero delle scelte economiche a cui il New Yorker medio può attingere è sbalorditivo». Misurato in stock keeping units (SKUs), misura impiegata dai venditori al dettaglio americani per calcolare il numero dei tipi di prodotto venduti nei negozi, il New Yorker si confronta con un ammontare di possibili opzioni comprese tra 106 e 1010 (10 miliardi), mentre gli Yanomomö hanno una gamma di scelte intorno a qualche centinaio.

Ancor più stupefacente di quello appena indicato è un altro aspetto: il percorso dell’umanità dalla società di cacciatori-raccoglitori al mondo moderno è durato 15000 anni ed ha mostrato un’accelerazione esponenziale negli ultimi 250 anni. Secondo le stime di Bradford DeLong ci sono voluti 12000 anni per passare dai 90 dollari pro-capite dei cacciatori-raccoglitori ai 150 degli antichi Greci nel 1000 a.C. Nel 1750 d.C. si sono raggiunti i 180 dollari pro-capite; da metà dell’800 ad oggi il PIL pro-capite è cresciuto 37 volte fino all’attuale livello di 6600 dollari.

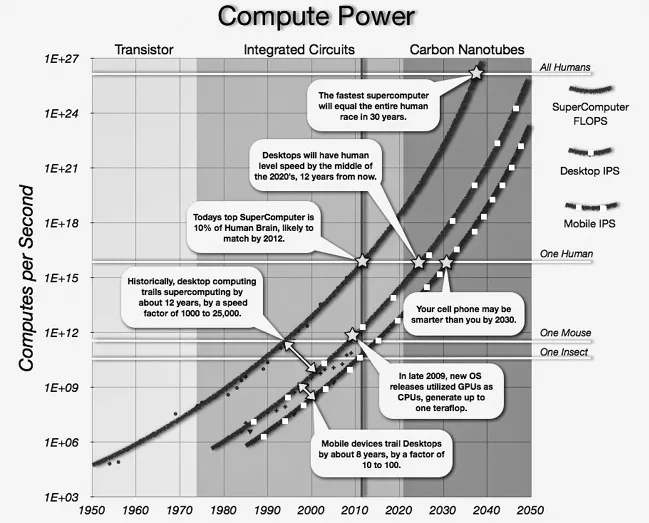

Figura 1 – Aumento esponenziale della potenza computazionale. [Fonte: <https://thinkexponential.com/2013/04/08/exponential-technology/>]

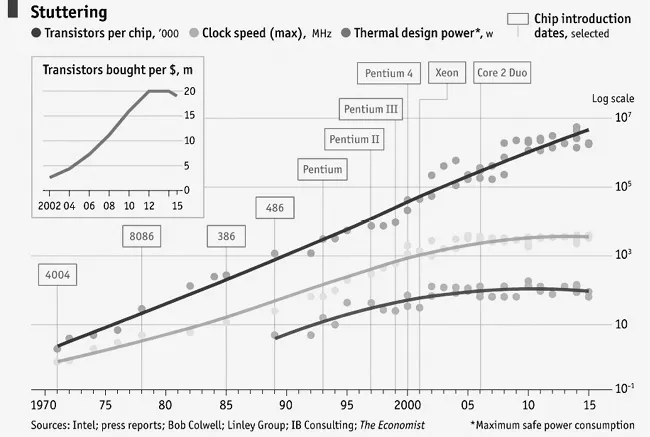

Figura 2 – Legge di Moore. [Fonte: The Economist, 2016

Accelerazione e aumento del potenziale di scelta sono quindi due aspetti da cui partire per comprendere la traiettoria verso la Fabbrica Intelligente.

Aggiungiamo ad essi altri due fattori quali l’aumento della potenza computazionale negli ultimi cinquanta anni (Fig. 1) e la conferma (finora) della cosiddetta ‘legge di Moore’: la potenza dei computer raddoppia ogni due anni allo stesso costo (Fig. 2).

Bisogna anche tenere presente che la ‘frontiera computazionale’, per così dire, è in continuo avanzamento, dati i passi in avanti che la ricerca scientifica sta compiendo in alcune direttrici (The Economist, 2016):

- Optical communication, cioè uso della luce anziché dell’elettricità nella comunicazione tra dispositivi computazionali;

- Better memory technologies, nuovi tipi di memoria più veloci, dense e meno costose per superare ‘colli di bottiglia’ nelle performance dei computer;

- Quantum-well transistors, transistor che usano il ‘pozzo quantico’, ovvero un fenomeno quantistico che altera il comportamento di ‘portatore’ di cariche elettriche nei transistor, migliorandone così estremamente la performance nel senso della legge di Moore;

- Developing new chips and new software, per automatizzare la scrittura dei codici-macchina mediante cluster di chip specializzati;

- Approximate computing, che consiste nel creare rappresentazioni meno precise dei numeri interne ai computer, in modo da ridurre la quantità di bit necessari per eseguire i calcoli e quindi risparmiare energia;

- Neuromorphic computing, basato su dispositivi modellati sui meccanismi connettivi tra neuroni che elaborano informazioni nei cervelli degli animali, le cui abilità di riconoscimento dei pattern (configurazioni ordinate dell’ambiente) sono ancora irraggiungibili per i dispositivi artificiali, rispetto a cui mostrano un’efficienza molto maggiore attraverso i consumi energetici molto minori proprio nelle attività di information processing (vedi citazione di Bruno Michel);

- Carbon nanotube transistor, grazie all’impiego di rotoli di grafene dello spessore di un atomo, che consentono un «minor consumo di energia e alta velocità di elaborazione» (Bourzac, 2013)1.

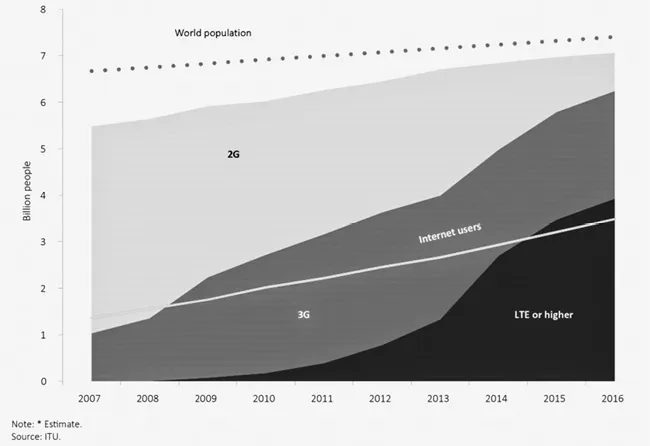

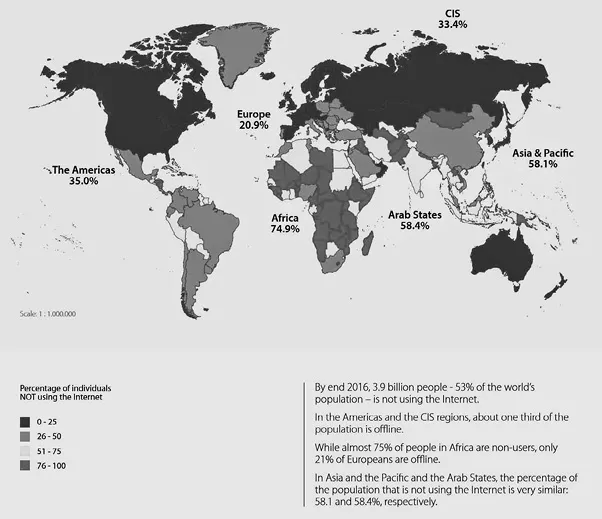

A tutto questo bisogna poi aggiungere un altro fattore di grande importanza: la progressiva creazione di uno spazio connettivo globale ad alta intensità di flussi informativi (Fig. 3). Dalla figura 3 si evince che il 95% della popolazione mondiale (7 miliardi) vive in aree coperte da reti di telefonia cellulare, mentre prosegue l’espansione a ritmi esponenziali delle connessioni ad ampiezza di banda sempre più elevata (3G, LTE)2. In tale quadro il numero degli utenti Internet nel mondo cresce continuamente: 3.485.142.260 alle 17.44 del 24 ottobre 20163 (Fig. 4).

Figura 3 – Dimensioni quantitative dello spazio connettivo globale. [Fonte: ITU, 2016]

Figura 4 – Più di metà della popolazione mondiale non usa Internet. [Fonte: ITU, 2016]

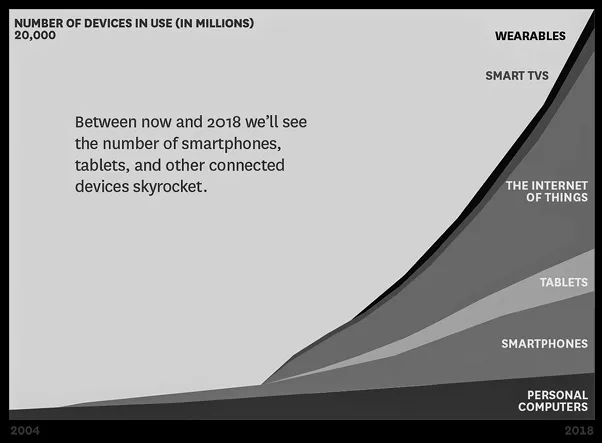

Figura 5 – Un’‘esplosione’ di dispositivi connessi. [Fonte: Iansiti e Lakhani, 2014]

Gli elementi indicati definiscono innanzitutto uno scenario caratterizzato da un’intensa dinamica evolutiva, i cui meccanismi propulsori sono indubbiamente la connettività digitale e l’aumento esponenziale della potenza computazionale a disposizione degli agenti individuali e collettivi.

Immaginiamo ora che in questo panorama tecnico-scientifico si inseriscano nuovi elementi quali la pervasività di dispositivi che elaborano informazioni, miniaturizzati e inseriti tendenzialmente dappertutto: nelle materie prime e in tutti gli altri input dei processi produttivi, nei prodotti. Questi dispositivi (sensori, attuatori, effettori ecc.) sono in grado di rappresentare in forma digitale tutti gli eventi e le variabili ambientali che possono influenzare gli oggetti in cui sono inseriti. Siamo di fronte alla digital ubiquity (Iansiti e Lakhani, 2014), conseguente alla diffusione dei cyber physical systems (CPS)4, cioè sistemi di «embedded hardware and software» (Acatech, 2011: 20) che permettono la creazione e lo sviluppo di flussi informativi incessanti, i quali sono generati dalle interazioni che si sviluppano tra la miriade di processi e output esistenti in uno spazio connettivo globale (Fig. 5).

Connessioni attive tra entità che processano informazione indipendentemente dall’intervento umano aprono nuovi orizzonti di progettazione e creatività non predeterminabili per una ragione evidente: sorgono strutture interattive flessibili, correlate a scambi informativi, i quali possono creare le condizioni per generare nuove conoscenze attraverso la combinazione di più domini conoscitivi, la riformulazione di quelle già possedute, la scoperta di nuove direttrici di creatività sulla base di input della più varia provenienza. Siamo quindi entrati nell’era dei cyber-physical systems, che rendono i prodotti e i processi ‘intelligenti’, perché incorporano – grazie alla digital ubiquity – la capacità di interagire con l’ambiente, come vedremo nei capitoli seguenti, a molteplici scale: nano-, micro-,meso-, macro. Il fatto che sia possibile rappresentare processi e output in configurazioni di bit, a loro volta modificabili in base all’arrivo di segnali, dati e informazioni crea un territorio inesplora...

Table of contents

- Introduzione

- Capitolo 1

- Capitolo 2

- Capitolo 3

- Capitolo 4

- Capitolo 5

- Capitolo 6

- Capitolo 7

- Bibliografia

Frequently asked questions

Yes, you can cancel anytime from the Subscription tab in your account settings on the Perlego website. Your subscription will stay active until the end of your current billing period. Learn how to cancel your subscription

No, books cannot be downloaded as external files, such as PDFs, for use outside of Perlego. However, you can download books within the Perlego app for offline reading on mobile or tablet. Learn how to download books offline

Perlego offers two plans: Essential and Complete

- Essential is ideal for learners and professionals who enjoy exploring a wide range of subjects. Access the Essential Library with 800,000+ trusted titles and best-sellers across business, personal growth, and the humanities. Includes unlimited reading time and Standard Read Aloud voice.

- Complete: Perfect for advanced learners and researchers needing full, unrestricted access. Unlock 1.5M+ books across hundreds of subjects, including academic and specialized titles. The Complete Plan also includes advanced features like Premium Read Aloud and Research Assistant.

We are an online textbook subscription service, where you can get access to an entire online library for less than the price of a single book per month. With over 1.5 million books across 990+ topics, we’ve got you covered! Learn about our mission

Look out for the read-aloud symbol on your next book to see if you can listen to it. The read-aloud tool reads text aloud for you, highlighting the text as it is being read. You can pause it, speed it up and slow it down. Learn more about Read Aloud

Yes! You can use the Perlego app on both iOS and Android devices to read anytime, anywhere — even offline. Perfect for commutes or when you’re on the go.

Please note we cannot support devices running on iOS 13 and Android 7 or earlier. Learn more about using the app

Please note we cannot support devices running on iOS 13 and Android 7 or earlier. Learn more about using the app

Yes, you can access Fabbrica 4.0: i processi innovativi nel Multiverso fisico-digitale by Mauro Lombardi in PDF and/or ePUB format, as well as other popular books in Economics & IT Industry. We have over 1.5 million books available in our catalogue for you to explore.